2018.08.17

#Introduction

「人間と人工知能の相互補完」をライブコーディングを通して伝える

──Ai.stepの活動を簡単に教えていただけますか?

白石:Ai.stepはAI(人工知能)を使ってライブコーディングを行なっています。完全に人間をAIに置き換えるのではなく、人間と人工知能が相互補完する関係を持つことでできる音を目指して活動しています。

──人工知能と人間の相互補完のどこに魅力を感じたのでしょう?

白石:僕は普段からずっとプログラミングをやっているので、こういうコードを書くとこうなるという結果がわかるんですね。でもAIを使えば、自分が予測ができないコードが生まれるので面白いんです。

AIをつくっているのは自分ですけど、自分が作ったAIが自分が考えられなかったアウトプットを生み出すのは新鮮です。

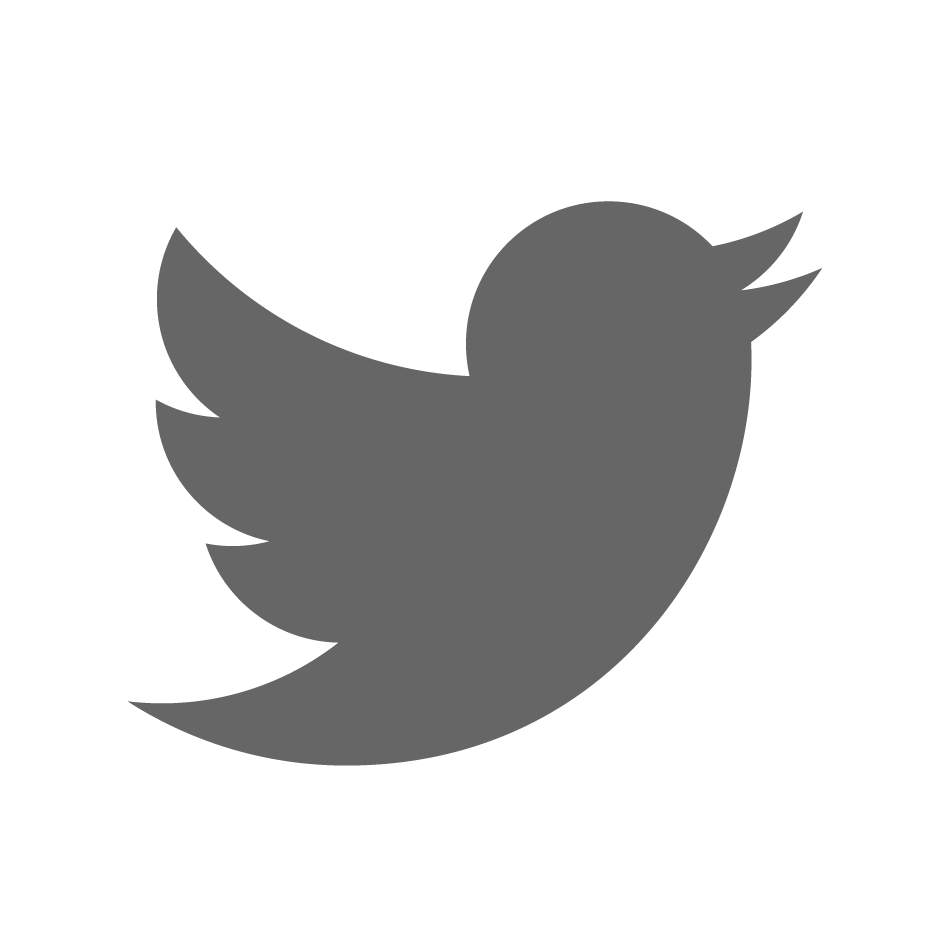

Ai.step(アイ・ステップ)。左:Scott Allen/右:白石覚也。

──2人の役割はどのようになっていますか?

白石:僕がAIの開発と、ライブコーディングの音の部分を担当して、

Scott Allen:僕が、音の情報から視覚化しています。ライブコーディングで出された情報を使って、コンセプト(AIと人間の相互補完)の実現のために視覚化しています。

VIDEO

2017年9月22日 Interim Report edition2でのパフォーマンス

──ライブコーディングで、AIと人間の相互補完が見ている方に伝わっている手応えってありますか?

白石:今のところはないです(笑)ちゃんと説明した人には「あー」って言ってもらえるんですけど。

Scott Allen:テキストと音しか見えないので、AIがどのように音に作用して、それに対して白石がどんなアクションをしているのか見えないんです。結果として、不規則な音が自動生成されているように聞こえるという。

「何やっているのかわからない」っていうのが、最初の感想として頂いていて、今は視覚化の部分でAIの説明を兼ねるようにシフトしています。

制作環境

──自作しているソフトウェアは、たとえばどんなものですか?

白石:たとえば、人工知能のモデルからテキストを引っ張ってくる部分とか、自分のアクションをAIが出したコードの羅列に入れ込む部分は自分で作っています。言語はJavaScriptです。

Scott Allen:パフォーマンス中は、白石が僕にコードのテキスト情報を「OSC」プロトコルで送ってきて、僕が自身のプログラムを通して映像化しています。他には、白石のテキストエディタのテクスチャを「NDI」プロトコルで、LANケーブル経由で貰ったり。

彼がオープンソースのエディタ「Atom」を改編して、OSCでテキストを送ったり、テクスチャを送る機能を追加しています。逆にそれがなかったら、僕の視覚化の部分もどうしようもないんです。

──ソフトウェアは自作しないとないものなんですか?

白石:探せばあるかもしれないですけど、無駄な機能がないので自分が使いやすいのと、不具合がおきたときに自分で書いたほうがわかるんですよ。

──AIには何のデータを学習させていますか?

白石:TidalCyclesのソースコードをひたすら学習させています。だから音ではなく、テキストファイルですね。

──ソースの数はどれくらいですか?

白石:一つ一つのテキストの長さは違うんですけど、ファイルは7万個くらいですね。TidalCyclesの拡張でヒットするファイルをひたすらGitHubでダウンロードしたり、自分で簡単な2行くらいのコードを書いて用意しています。

Scott Allen:自分のコードもあるんだ(笑)

──自分のコードばっかり学習させたら自分のAIになりますね(笑)

弱冠23歳のAIクリエイター 白石覚也

──白石さんのAi.step以外の活動を教えてください。

白石:今はIAMAS(情報科学芸術大学院大学)の学生をしています。Ai.step以外は、ビジュアル・プログラミングを用いてインスタレーションのシステムや映像を作っています。去年くらいから、AIを使った作品が多くなってきました。

──白石さんはもともと音楽もやっているんですよね。全方向的に活動されていますが、軸になっているものはなんですか?

もともとバンドをやっていたので、やっぱり音が好きですね。映像を作るときも音の雰囲気に合わせて作ることが多いので。

──音楽以外のことを始めたのはなぜですか?

IAMASの前は多摩美術大学に行っていたんですが、さらにその前は高専に行っていて、工学系のこと、いわゆるプログラムをずっと学んでいました。そこで音と並列してプログラミングもしていたので、音の視覚化をしていくうちにビジュアルのほうへ行っていました。

──今のようなアーティスト活動をしたいとは思っていましたか?

白石:全然、思っていなかったですね。小さい頃から工学が好きだったんで、美大になんて行くとも思っていなかったですね。合わなくなってきて分野変えたくて、多摩美ってのもあるんで。

影響を受けた人 - 白石覚也:

──いろんなミュージシャンやメディア作家がいたりするなかで、徳井さんはどっち側の存在に見えますか?

──純粋な音楽としての良さより、たとえばAI DJの取り組みやアプローチの面白さに影響を受けている感じでしょうか?

「コンテンツ=メディア」の時代、映像の源流に立ち返る像楽家 Scott Allen

──では、Scott Allenさんにもお伺いしたいのですが…まず名前って、触れていいんですか?(笑)

白石:俺も今日なんて説明すればいいのかなって思ってました(笑)

Scott Allen:ガチの外国人とウソの外国人のアーティストさんがいますが、僕はウソのほうなんで…。

──Scott Allenの由来はなんでしょうか?

VJネームを考えるときに、海外で活動したときも読みやすいようにしよう、っていう謎の気持ちも微妙に働いて、本名のイニシャルからとったりしてScott Allenになりました。こういう理由でこの名前なんです、みたいなものはないです。でも結果的に、この名前が話のフックになることも多いので、よかった気がしています。

──なるほど(笑)では、Ai.step以外の活動について教えてください。

基本的には視覚メディアを扱っています。白石と同じくIAMAS出身で、今は作家として活動しています。その活動のなかに、パフォーマンスもあるし、クラブフォーマットの活動もあります。それ以外だと、鏡なんかの屈折反射を伴うモノによって、レーザーの光を変化させ、壁に投影するパフォーマンスも個人制作でやっています。

──活動に一貫してある、表現したいことはなんですか?

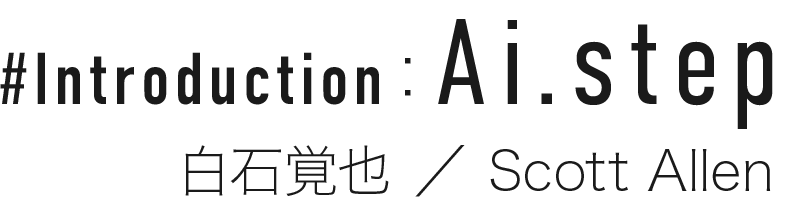

Scott Allen:これまでの視覚メディアの発展から語ると、シネマトグラフで映画が発明されて、フィルムになり、デジタルになりました。つまり、すべての空間がピクセルに分断されているんですね。さらに言うと、静止画が1秒間に何回か切り替わるフレームレートの概念があるじゃないですか。フレームが分断されている、すなわち時間も分断されています。今の映像というのは、時間的にも空間的にも離散的になっています。

僕は、視覚メディアを源流から捉えたものを表現したいと思っています。すごく昔の視覚メディアで「幻灯機」という、ガラスに描かれた画像をランプとレンズで投影するメディアがあります。僕はそのレベルまで立ち返って、フレームレートもなければピクセルもない映像をどうやって作るか? 視覚メディアが現在と違った進化を辿っていたらどうなっていたのか?というのがモチベーションで、作品をつくっていますね。

──プロフィールの「像楽家(ぞうがくか)」という肩書きが気になったんですが、そういう意味合いなんですね?

Scott Allen:そうですね。

Scott Allen:IAMASに三輪眞弘さんという先生がいますが、音楽について三輪さんが語っていることに映像を対応させて考えたときに、ちょうど自分が目指しているものと合致しました。

そこで語られていた音楽の概念は、映像にも存在するけど、これまで映像の分野においては位置付けられていなかったなと。だから、その考え方で言う音楽の位置に像楽が定義できるのではないかと思いました。

デジタイズされていない、いわゆる生音(なまおと)に対応させて、僕は生像(せいぞう)と呼んでいるのですが、それを使ったパフォーマンスやインスタレーションを作っています。

音楽に対応する「像楽」http://spring.scottallen.ws/

──IAMASのときに得たことが、今に繋がってきたと。

Scott Allen:そうですね。もともと僕はVJをやっていたんですけど、それがどんどんリアルタイムな生成かつ、アーティストとコンピューターの低レイヤーでのインタラクションが発生する表現になっていきました。

そういった表現をするなか、どこまで行けば“演奏”になるのかという疑問がずっとあって。音楽の定義や三輪さんの話を考えたときに、映像も同じようなやり方ができるんじゃないかと思って、今の像学の活動に繋がりました。

──今の活動の上で、プロジェクションとか、スクリーンからの脱却という意識は結構あるんですか?

Scott Allen:デジタルでいえば、今は「コンテンツ」と、それをプレイバックする「メディア」が分断されているんですけど、昔は「コンテンツ=メディア」だったんですね。そのコンテンツ=メディアの延長で、いかに今でしかありえない表現ができるかをいつも考えています。この考え方は、IAMAS時代の恩師であるクワクボリョウタさんに影響を受けています。

逆に「これなんでもいいじゃん」ってものにグッと来ないんですね。よく僕もVJではやっちゃっているんですけど、たとえば白石が出した音に映像を合わせるときに、ライブコーディングのテキストデータをCGに起こしたとしても、そのCGってどんなものでもいいんですよね。対して、実空間で光が反射して、投影されるのは原因と結果が一つしかなくて、惹かれます。

──ちなみに、もともとはどこのカルチャーにいたんでしょう?

Scott Allen:もともとはバンドをやっていました。

──Scottさんも音楽から映像に移行したんですね。

Scott Allen:バンドでも、VJで入っている人がたまにいるじゃないですか? そういう音源だけで勝負するより、ライブの空間をどう作るかみたいなダイナミズムに興味があって、自分も始めました。とりあえず「After Effects」とか触ってみようみたいな感じで。そこがバンドからVJへの移行ですかね。

──大学では今の活動に直結することを学んでいたのですか?

Scott Allen:いえ、大学は物理系の学科だったので、白石のようにリニアには繋がっていないです。ただ、今は光の反射や屈折を扱っているので、なんだかんだ大学で学んだ内容を活かせることはあります。なので、作品を展示していて嬉しいのは光学系の技術者の方などからもポジティブな意見をいただけることです。。そのような光の作品を作れるのは、物理を勉強していたのが役立っていますかね。

影響を受けた人 - Scott Allen:

──最近、印象に残っている作品はありますか?

Scott Allen:後藤映則さんの作品ですね。目指しているものとすごく近いです。

フィジカルなで光を扱っていると、手法がそこまで多くないし、デジタルのようにパパッと作れないですし、実空間の制限のあります。ですが、この作品はそういったことを乗り越えて作られているので、本当にすごいと思いました。

AI作家、あるいは像楽家になるには?

──AIを使った表現をやりたい場合、どう入っていけばいいですか? 仮にそういう人がいた場合、どうアドバイスしますか?

白石:自分もAIに関しては0から勉強したので、まずは実装する勉強ですね。実装できるひとを捕まえるっていうのもありますが、アイデアがあっても実装できないと表現するのは難しいので。自分はバッググラウンドに音楽があって、その表現のためにAIを実装しようと勉強していきました。

──たとえばライブコーディングをやろうってなると、TidalCyclesを触るというシンプルな入り口がありますが、AIの分野ではまだ整っていないですか?

白石:ないですね。AIは分野が広すぎるので、自分で作っていかないとしょうがないです。やりたいことを決めてから実装の勉強を始めたほうがいいですね。

──AIが手段じゃなくて目的になっちゃうと難しいと。

白石:そうですね。

Scott Allen:AIだけじゃなくて、コンピュータアートとか機械を使った作品という文脈でも、時代が何周もしているっていう話があって。コードを書く実装でないところでいうならば、何世代か前の機械vs人間が唱えられていた20世紀の話とかも読むと、今のAIを使った芸術の参考になるかも。媒体は変わって、主張は変わっていないみたいなところもありますからね。

──像楽家になるにはどんな入り口がありますか?

Scott Allen:コンピュータをちょっと触ったらアウトプットできる時代なので、逆に身近なもので視覚的に綺麗と思ったものを、コンピュータのシミュレーションではないところで再現することですかね。って言っちゃうと先祖返り感あるんですけど(笑)

何でもできるコンピュータじゃなくて、メディアにしかできないことを考えて、何かを作ってみるといいのかなと思います。これは映像だけではなくて、いろんな分野に言えると思います。

Ai.step

Ai.stepは、Kakuya ShiraishiとScott Allenによるユニットです。人間のパフォーマーと機械学習に基づく「AI」が共にライブコーディングを行い、演奏及びデータビジュアライズのパフォーマンスを行います。演奏では、音響合成プログラミング言語であるTidalCyclesのコード生成と記述の部分に、ディープラーニングを使用します。パフォーマンス中、AIは画面上のエディターに表示されるコードを生成しています。そこから生まれる演奏情報を聞き、パフォーマーが音色を選定していきます。AIの生成結果を人間がナビゲートすることで、人間とAIの間の相互補完をライブコーディングを通じて実現します。データビジュアライゼーションでは、AIが生成する音色の情報、パフォーマーのアクション、両者の関係性を視覚的に表現します。

Related

Ai.step(アイ・ステップ)。左:Scott Allen/右:白石覚也。

Ai.step(アイ・ステップ)。左:Scott Allen/右:白石覚也。