2018.08.17

#Introduction

Interim Reportをとおしてアウトプットする人や組織にインタビュー。活動内容やその背景、制作環境について聞く。

「生の音」を拡張する現代音楽家

──まず、大久保さんの活動の本分に「現代音楽」がありますが、どのような活動を行なっているんですか?

生の楽器や楽譜にテクノロジーを組み込んで、従来の生演奏を拡張する活動をしています。つまり、電子音楽が生まれた時代背景を取り入れて、生の演奏を拡張するということですね。そのほかは劇伴音楽の作曲をしたり、音響や録音をしています。

──作品のアウトプットとしてはどのような形になるのですか?

もともとは、「スピーカーを使って音を鳴らすコンピュータ音楽」をずっとやってきたんですけど、最近になって、「コンサート会場で生演奏をするコンピュータ音楽」の形態になりました。

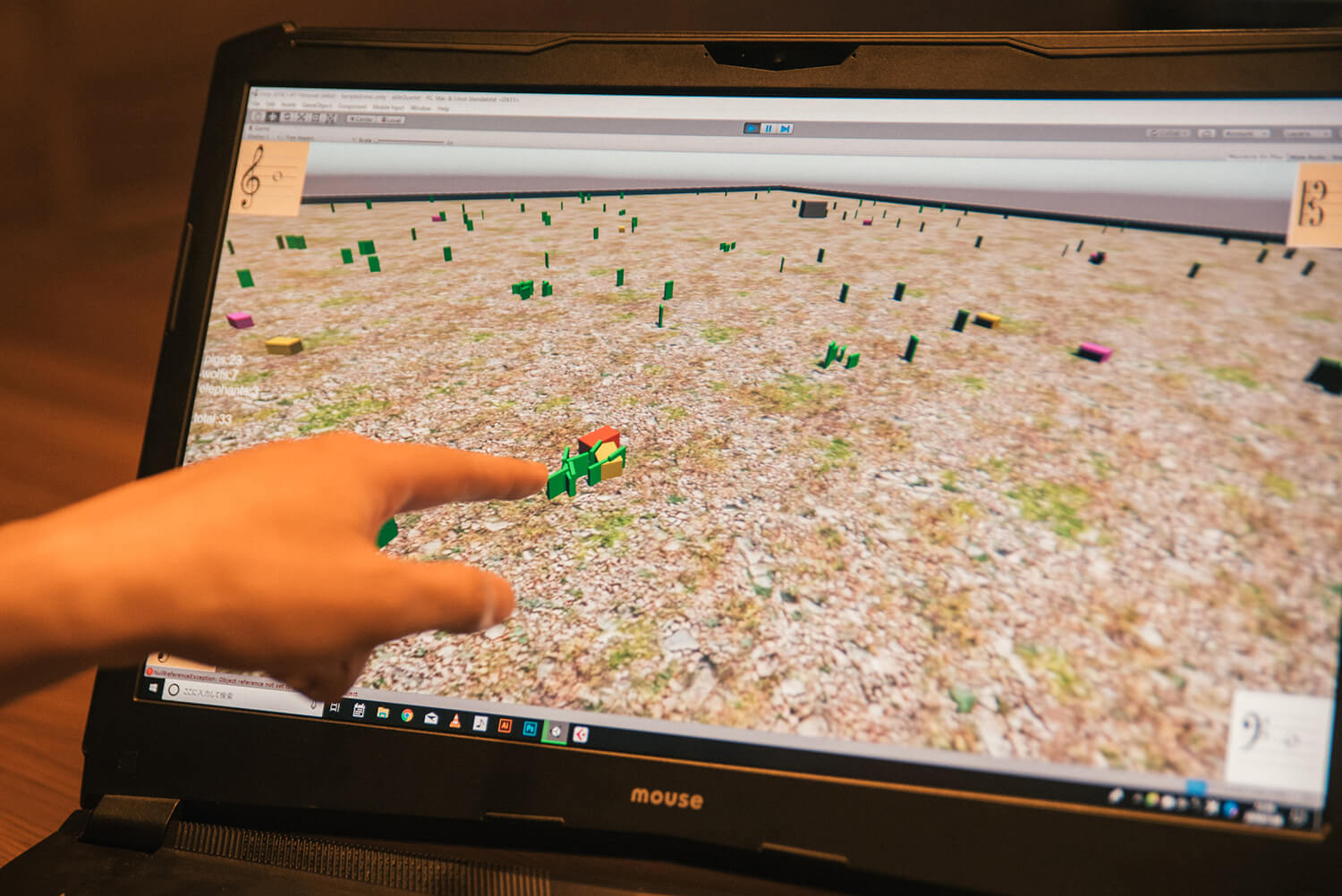

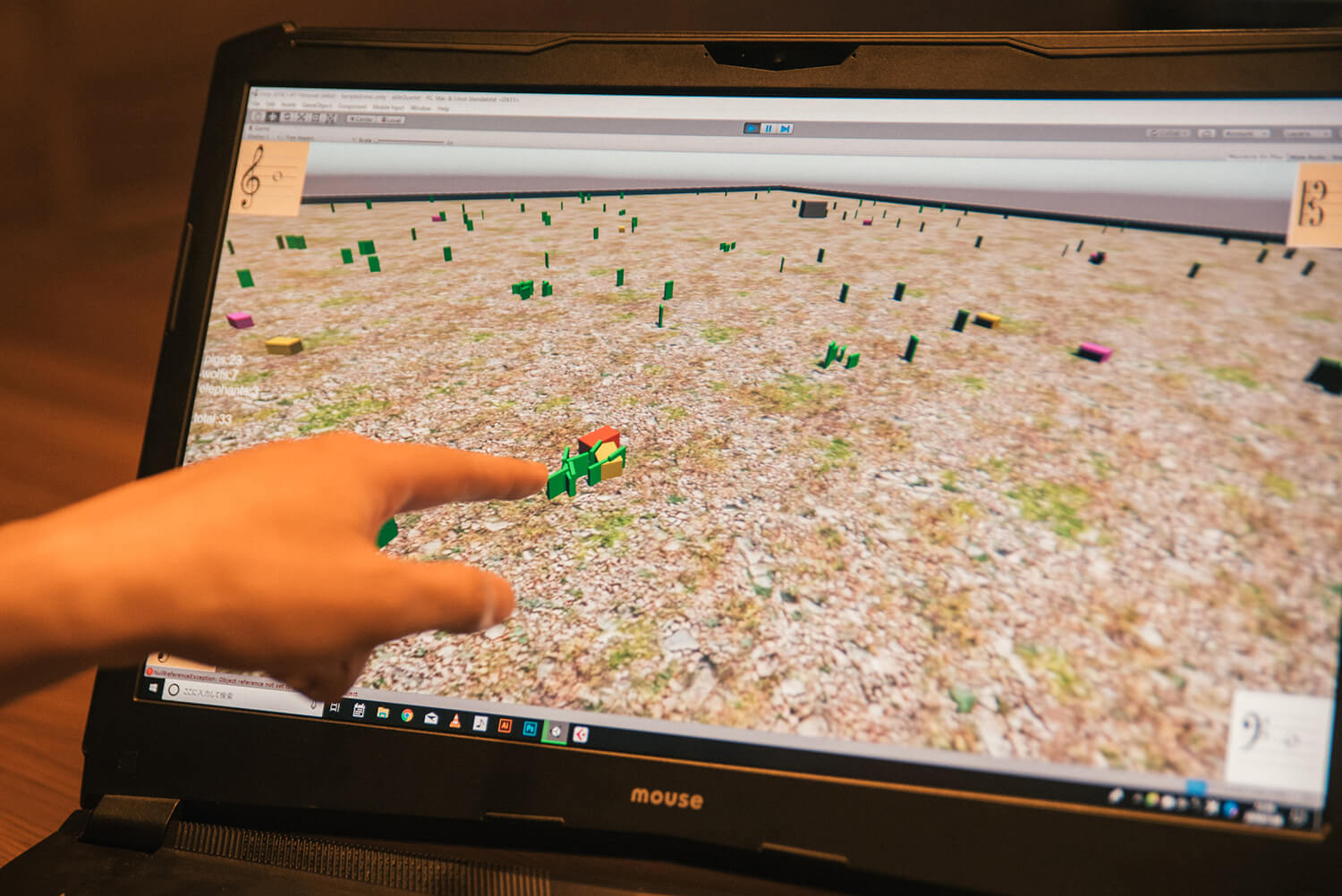

実はいま、仙台で『絶頂』というコンサートのシリーズを企画しています。ここで出品するのは映像+弦楽四重奏の作品です。映像というのは、具体的にはゲームエンジンの「Unity」で作った人工生命の環境で、なかで肉食動物が草食動物を食べたりといった自然環境をシミュレートしたものです。これが、弦楽四重奏の演奏のきっかけになるんです。

Unityで制作された人工生命の環境。一見、音楽とは無縁そうな制作画面だが、『絶頂』で演奏されるのは4隅の音符である。肉食動物(黄色)が草食動物(オレンジ)を食べている様子。肉食動物、草食動物を含め4つの個体が生息して、人工の生態系を生きている。『絶頂』では、個体の合計数や、それぞれの個体数などで演奏する音程やBPMが決定する。

Unityで制作された人工生命の環境。一見、音楽とは無縁そうな制作画面だが、『絶頂』で演奏されるのは4隅の音符である。肉食動物(黄色)が草食動物(オレンジ)を食べている様子。肉食動物、草食動物を含め4つの個体が生息して、人工の生態系を生きている。『絶頂』では、個体の合計数や、それぞれの個体数などで演奏する音程やBPMが決定する。

たとえば、この作品には「現代の音楽の聞かれ方」に対する批判が含まれています。音楽は音に情報が込められているので、本来なら集中して聞くものですが、今の時代、作業しながら聞くものになっていたり、映像と一緒になって当たり前、むしろ映像のほうが強くなったりしています。それを逆手にとって、映像に合わせる音楽をコンサートで演奏してしまおうと思ったんです。

『絶頂』ではお客さんはじっくりステージを見ているんですが、集中しているのは映像のほうという不思議な構図が生まれるんです。「音楽の聞かれ方が変わった」という現象を提示をしたいと思っています。

現代音楽は「フォーマット化する大衆音楽」の緩和剤

──『絶頂』の公式ページに書いてある、「現代音楽ほど創造的で、音楽の聴き方を広げる音楽はない」という言葉が印象的です。これ、どういう意味ですか?

現代音楽の作品は、すでに作られた音楽に対して、聴き方を拡張するために作られているものが多いと感じています。拡張とは、その作品を通して知らなかった体験や考え方ができるということですね。

で、そのページに載せているのは、大衆音楽に対することを書いています。

いわゆる大衆音楽っていうのは、形が一定じゃないと多くの人が認知しにくいので、音楽的に固定されてしまっていると思っています。相変わらず“ABサビAB”みたいな形式はあるし、多くの人に受け入れてもらうにはフォーマットを合わせないといけないんですね。もちろん、それでもすごくカッコいい曲はいっぱいあるんですが。

そういった大衆音楽に対して、音楽のフォーマットや聞き方をもっと豊かにできるのが現代音楽だと思います。たとえば、現代音楽で有名な作品にジョン・ケージの『4分33秒』がありますよね。当時コンサートで演奏される音楽といえば、ステージ上で演奏される音の情報だけでした。そこで4分33秒は、「ステージで演奏しないの?」という驚きで観客をざわざわさせたんですね。そのざわめきが音楽になっていて、ホール全体にある音が音楽に含まれるという聞き方を広げたんです。そういった音の聞き方の解釈を広げるのが現代音楽だと思っています。

制作環境

──プログラミング系の制作環境は「Max」のみですか?

『私は.mp3の中で座っています』という音楽作品で、4秒の「私はmp3の中で座っています」という音声を320回も圧縮するのが面倒だったので、Pythonは使いました。けど、決まって使うのはMaxですかね。

──ツールありきではなくて、作品ごとに使い分けているのですね。

そうですね。『絶頂』の人工生命の映像はUnityですし。

触ってみないと何ができるのかわからないので、色々なソフトをとりあえず触っていますね。ふとやりたい表現を思いついたときに、それを処理するのが得意なソフトがわかるので。

たとえば『絶頂』の人工生命の映像は、動物たちが食べあったりするので、1つのオブジェクトごとに処理ができて、物理の処理もできるUnityなら実現できるな、と思って使ったんですけど。

──大久保さんの場合は制作のコンセプトがしっかりと立っているから、ツールありきにならないんですね。

でも僕もコンセプトは後付けですよ。自分が面白いと思いついた表現から入っていくので、コンセプトより「どんな音が鳴るか?」ということが先行しています。

たとえば「トランスデューサー」という机とかに貼って使う振動型のスピーカーがきっかけになっている作品があるんですね。トランスデューサーって触るとブルブルするんですけど、これを打楽器につけると人が叩かなくてもけっこう音が鳴るんです。

これを作品に落としこんで、パーカッショニストのスネアの即興演奏を、誰もいないスネアで再現するものを作りました。スネアの膜の振動をマイクで記録して、スネアにトランスデューサーをつけて再現したんです。同時に映像も撮影して、それをループさせたり速度を変えたりして、スネアの音もそれに合うように加工しました。

その信号をトランスデューサー越しにスネアに伝えると、誰もいないスネアが生演奏しているように鳴るし、映像の速度を変えれば、スネアの音は電子処理された音になるけど、実際のスネアがその通りに鳴ってくれるから気持ち悪くて。

組み合わせによってできた面白いものが、従来の表現とはどう違うのか考えて、コンセプトを固めていきます。コンセプトができてから、最終的にどのような演奏や音色に仕上げるか考えています。

──表現、コンセプト、仕上げの順番って、現代音楽だと一般的ですか?

どうなんでしょうね。すでに自分の技法を確立している人ならコンセプトから考えるかもしれないですが、僕はぼやっとしていますから。面白いことをしたい、ということが先行にあります。

音楽もプログラミングも大学から始めた

──現代音楽の活動をするまでの経緯は?

音楽を始めたのは小学校の頃ですが、高校か中学の終わりのころに『beatmania(ビートマニア)』という音ゲーをやって。そこでトランスというジャンルに惹かれて、自分でも作るようになったんですね。そのほかはずっとダンスミュージックを聴いてたり、民族音楽が好きだったので楽器を触って遊んでいました。

そのあとは音楽大学に行きました。もっと音楽を理解したかったので、それならクラシック音楽を勉強しようと。入ったのは「音楽・音響デザインコース」という音響やDTMを学ぶコースだったんですが、共通科目でクラシック音楽について勉強しました。

そこで就いた森威功先生が、楽器の音に対してMaxでエフェクトをかけてスピーカーで再生する、いわゆる「ライブエレクトロニクス」の形の作品を発表している方でした。

その先生に就いて、「ミュージック・アクースマティック(環境音や電子音を使った音楽)」を中心に作曲するようになったんです。この音楽は、虫の鳴き声、鳥の鳴き声、川の音、波の音、森の葉っぱが当たってザラザラする音、そういった自然の音をレコーディングし、編集や波形自体にエフェクトをかけます。素材を組み合わせて音楽を作り、最後にはCDやデータの媒体でアウトプットします。大学では、そういった音楽をしばらくやっていました。

──そこがいわゆるDTMではない作曲を行なった瞬間なんですね。

ただ、そういった音響系の音楽をしばらく続けていくと、スピーカーの中だけの音楽っていうのに面白くないと思ったんです。スピーカーのなかでデータからアナライズされるとなると、多くの人に楽しさを共有できないなと思って。つまり僕の音楽を友達に聞かせたけど、全然わからないっていう反応が多いんですね。それは寂しいので。

それで大学卒業後に、IAMAS(情報科学芸術大学院大学)に入りました。それまでの電子音楽の活動を使って、実際の空間で電子音楽を鳴らせたら面白いんじゃないかと思ったんです。

IAMASでは、三輪眞弘先生に就きました。「アルゴリズミック・コンポジション」という分野(コンピュータ・アルゴリズムを用いて音楽を作る)のことをやっている先生です。それまでアルゴリズミック・コンポジションというのは、ある規則的なコンピュータの計算を音符に置き換えて、楽譜として完成したり、スピーカーで再生されるものでした。ですが、三輪先生が新しいのは、その計算自体を生演奏に置き換えたんです。

IAMASではそういった環境で学び、今まで培ってきた音響処理やコンピュータ音楽の作り方、それらを生演奏でアウトプットすることに、生演奏の未来があるんじゃないかと思って、「従来の生演奏を拡張する活動」をしています。

──音大に入るタイミングでは、DAWソフトで作曲していたわけですよね? それから音大に入ってクラシック音楽を学びつつ、Maxのようなプログラミング的なアプローチも同時に始めたんですか?

そうですね。大学ではDAWソフトでの作曲と、五線紙で楽譜を書いていて。Maxに関してはこれをどう使ったら面白いのか全然わからなくて、大学時代では、先生からもらったパッチを使って音を変えたり、一部の作品で使っていた程度ですね。本格的にプログラムを始めるようになったのは、大学を卒業してからです。

──Maxをチョイスしたのは先生が使っていたから?

そうですね。いろんな音楽をつきつめて行きたいってなったときに、Maxっていうソフトを使うと色々できるんだってことを知って使い始めました。途中で「Processing」も使いましたけどね。

Maxはオブジェクトを繋いでプログラムを組みますが、オブジェクトが沢山ありすぎて名前や処理内容がなかなか覚えらず。それでProcessingをやってみたら、プログラム処理の順序がわかるようになって、応用してMaxができるようになりました。

──現代音楽家はたくさんいますが、自分しかやっていないであろうアプローチはありますか?

──現代音楽家はたくさんいますが、自分しかやっていないであろうアプローチはありますか?

現代音楽といっても、生のタイプと電子音楽に分けられます。その2つの間にライブ・エレクトロニクスなどがあります。ライブ・エレクトロニクスというのは、作曲家が楽譜を書いて、演奏家が演奏し、その楽器から出てきた音を作曲家がマイクで録音して、エフェクトをかけて完成する音楽です。

ですが僕の場合は、楽器から出てきた音にアプローチするのではなく、楽器や楽譜に対してアプローチをしています。そこが特徴かなと思います。

たとえば先程話したように、楽器自体にトランスデューサーをつけたり、『絶頂』で披露する動的に変化する五線譜がそうです。作品の核となるのは、コンピュータ音楽の音響処理などの概念ですが、僕の作品は電子音をスピーカーで再生するものではなく、生演奏するものとして最終的にアウトプットされます。

好きなアーティスト、作品、音楽

Herman Kolgen(ハーマン・コールゲン)

『Seismik』

世界の地震計の波形データをリアルタイムで受信し、地面の揺れを増幅させて聞かせる映像+音声作品

『INJECT』

数日間ものあいだ人を水槽の中に入れ、その様子を撮影した映像作品

Cod.Act(コットアクト)

『Pendulum Choir』

油圧ジャッキに歌い手を固定しパフォーマンスする合唱作品

『Pendulum Choir』はめちゃくちゃ面白いですね。もともと作曲された音があって、それをパフォーマーが歌って、その上に音響処理がされている作品なんですが、エフェクト(音響処理)を生身の人間にかける構図が面白かったです。つまり、体をコントロールすることで筋肉が震えるとか、無理しているときに声がでるという。

あとは現代音楽の作曲家のRichard Barrett(リチャード・バーレット)も好きですが、一緒にグループを組んでたこともあるStefan Prins(ステファン・プリンス)がやっている作品も面白いです。その方は生演奏も電子音も扱うタイプの現代音楽をやっているのですが、作品の楽譜内に、楽器の段と一緒にMIDIキーボードの段が書かれているんです。演奏家が楽譜通りに演奏すれば、音源が再生されたり、音響処理がかかったりするので面白いですね。

──普段はどんな音楽を聴くんですか?

──普段はどんな音楽を聴くんですか?

音楽、聞かなくなってきましたね。

──音楽家は普段はあまり音楽聞かないっていうあるある(笑)

一番聴いているのはラジオですね。そんな回答ですみません(笑)

──たとえばスマホにこういう音楽入っているみたいな?

スマホにも音楽は全然入れてないですよ。あと外で音楽を聴きたくないですね。周りで鳴っている音のほうが面白くて。最近、家でよく聴くのは、小袋成彬さんか環ROYさんですかね。あと、作業中のBGMには現代音楽を垂れ流しにしています。無調の曲やスティーブ・ライヒのようなミニマル・ミュージックは意識を持っていかれにくいので。

なんというか、特定の音楽を聴き続けることは、それに没頭して、そういう音楽の人になってしまうのではないかと思ってしまいます。特定の音楽を極める人であればそれでも良いのかもしれませんが、僕は音楽を拡張したいと考えているので、距離を置いて俯瞰できるポジションに居たほうが良いのかもしれません。

クラシックを振り返れば、コンピュータは楽器である

──今後も活動を続けていく中で、どんな表現をしていきたいですか?

──今後も活動を続けていく中で、どんな表現をしていきたいですか?

今後も、根本は音楽だとは思います。ただ色々やりたがりなので、これは言い訳みたいに聞こえるかもしれませんが、本来なら1本の楽器に対しても取り組めることってめちゃくちゃあるんですよ。でも、作曲家はいくつもの楽器を扱うオーケストラの音楽を作るし、声を扱うオペラも作っている。そんなことがクラシックでは当たり前に行なわれてきたんですね。

だから現代でコンピュータで音楽を作るなら、僕はコンピュータで映像もプログラミングもやっていきたい。コンピュータも楽器の一つとして使っていかないといけないのかなって思います。音を知覚することが前提ですが、さまざまなテクノロジーやメディアを使って音楽を作っていくことは今後も続けていくと思います。

大久保雅基

1988年宮城県仙台市生まれ。アコースティック楽器や演奏行為にテクノロジーを組み込み、生演奏にデジタルの所作を融合させた作品を制作している。洗足学園音楽大学 音楽・音響デザインコースを成績優秀者として卒業。情報科学芸術大学院大学[IAMAS]メディア表現研究科 修士課程修了。現在は作編曲、録音、ミキシング、マスタリング、音響設計、音響装置の制作をしながら、名古屋芸術大学芸術学部芸術学科デザイン領域、愛知淑徳大学人間情報学部の非常勤講師をしている。先端芸術音楽創作学会、日本電子音楽協会会員。

Related

Unityで制作された人工生命の環境。一見、音楽とは無縁そうな制作画面だが、『絶頂』で演奏されるのは4隅の音符である。肉食動物(黄色)が草食動物(オレンジ)を食べている様子。肉食動物、草食動物を含め4つの個体が生息して、人工の生態系を生きている。『絶頂』では、個体の合計数や、それぞれの個体数などで演奏する音程やBPMが決定する。

Unityで制作された人工生命の環境。一見、音楽とは無縁そうな制作画面だが、『絶頂』で演奏されるのは4隅の音符である。肉食動物(黄色)が草食動物(オレンジ)を食べている様子。肉食動物、草食動物を含め4つの個体が生息して、人工の生態系を生きている。『絶頂』では、個体の合計数や、それぞれの個体数などで演奏する音程やBPMが決定する。